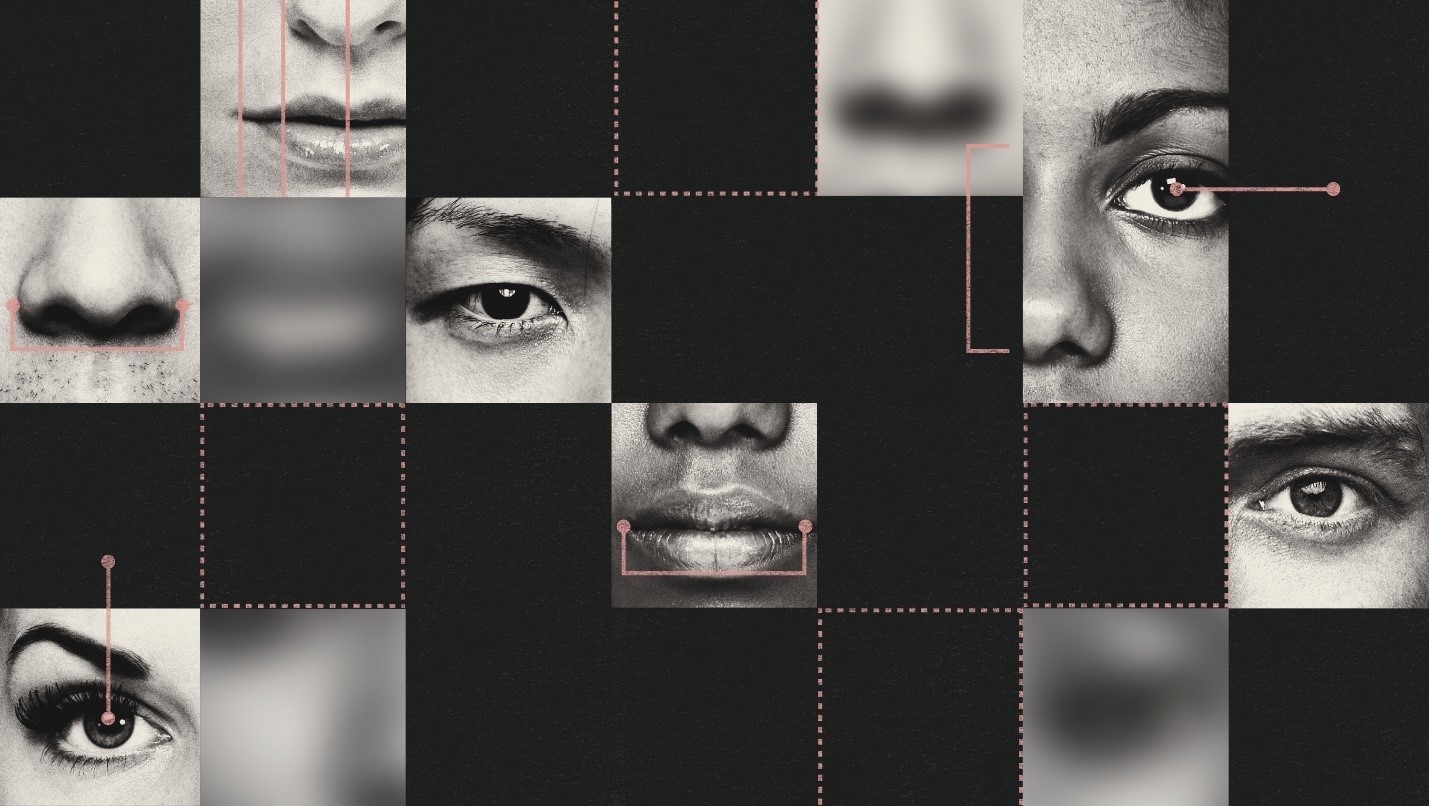

پیشرفتهایی که به تازگی در حوزه یادگیری عمیق حاصل شده دقت سیستمهای سنجش زیبایی مجهز به هوش مصنوعی را تا حد زیادی افزایش تغییر داده است. پیش از روی کار آمدن یادگیری عمیق، تحلیل چهره بر مهندسی ویژگی تکیه داشت؛ در مهندسی ویژگی هوش مصنوعی برای تحلیل چهره به درک و شناخت عمیق از ویژگیهای چهره وابسته است. به عنوان مثال، فرمول جذابیت یک چهره ممکن است چشمان درشت و خط فک باشد. سرج بلونژی، یکی از اساتید بینایی کامپیوتر در دانشگاه کرنل میگوید «فرض کنید به چهره یک فرد نگاه میکنید و تصویری به سبک نقاشی لئوناردو داوینچی، برای مثال با همان میزان فاصله میان چشمها و مواردی از این قبیل میبینید». به گفته وی، با پیدایش یادگیری عمیق، «توجه همه به سوی کلان داده و جعبه سیاههای بزرگ محاسبات شبکههای عصبی جلب شد که حجم بالایی از دادههای برچسبدار را پردازش میکردند.» وی در ادامه میگوید: «و در پایان مشخص شد عملکرد آن نسبت به سایر ابزارها و وسایل که دههها از آنها استفاده میکردیم، بهتر است.»

نکته اصلی هم همین است. بلونژی میگوید نحوه عملکرد آنها هنوز برایشان مشخص نیست، « افراد فعال در این صنعت از این فناوری رضایت دارند اما نحوه عملکرد آنها بر دانشگاهیان پوشیده اسا». زیبایی امری نسبی است، نهایت کاری که یک سیستم سنجش زیبایی مجهز به AI میتواند انجام دهد این است که همان معیارهای زیبایی که در طول فرایند آموزش بر روی آنها آموزش دیده را به درستی تشخیص دهد. با این حال امروزه برخی از سیستمهای هوش مصنوعی در مجموعه آموزشی، با نرخ دقتی برابر با انسانها به جذابیت افراد نمره میدهند که میتواند به این معنا باشد که به اندازه انسانها هم سوگیری دارند. مهمتر اینکه از آنجاییکه سیستمها نفوذناپذیر هستند و اتخاذ راهکارهایی برای به حداقل رساندن سوگیری الگوریتم دشوار و به لحاظ محاسباتی هزینهبر است.

به گفته بلونژی اپلیکیشنهای دیگری هم وجود دارند که مجهز به این فناوری هستند و عملکرد بهتری دارند؛ این اپلیکیشنها کارشان سنجش زیبایی و جذابیت افراد نیست و آسیبهای استفاده از آنها کمتر است-برای نمونه میتوان از ابزاری نام برد که میتواند زیباترین عکس از غروب آفتاب در تلفن همراهتان را به شما پیشنهاد میدهد. سنجش زیبایی امری کاملاً متفاوت است. به گفته وی سنجش زیبایی:« عملی ترسناک است.»

دادههای آموزشی و کاربردهای تجاری عاری از سوگیری و بیخطر هستند، اما بینایی ماشین به لحاظ فنی در زمینه تشخیص رنگ پوست انسانها محدودیتهایی دارد. به کمک تراشههای عکسبرداری به کار رفته در دوربینها میتوان طیف مشخصی از انواع رنگ پوست را پردازش کرد. از دیرباز «به برخی از رنگ پوستها کمتر توجه میشد »، «به عبارت دیگر، در عکسها هم برخی از این رنگ پوستها ظاهر نمیشدند. حتی پیشرفتهترین ابزارهای سنجش زیبایی هم شاید نتوانند در امر سنجش زیبایی افراد موفق عمل کنند، زیرا درجه روشنی پوست به درستی نشان داده نمیشوند.»

سوگیریها در قالب نژادپرستی و در اپلیکیشنهای تجاری نمود پیدا میکنند. در سال ۲۰۱۸، لورن روی، اقتصاددان و دانشیار سیستمهای اطلاعاتی در دانشگاه مریلند، کالج پارک، در هنگام خرید ابزارهای تشخیص چهره بود که به چندین محصول غیرعادی برخورد.

او میگوید: « متوجه شدم الگوریتمهایی برای سنجش و نمرهدهی زیبایی وجود دارد و با خودم گفتم چنین چیزی غیرممکن است. منظور این است که زیبایی در نظر هر شخصی میتواند متفاوت باشد. چگونه میتوان الگوریتمی را آموزش داد تا مشخص کند فردی زیبا است یا نه؟» پس از گذشت مدت زمان اندکی، این الگوریتمها به موضوع اصلی مطالعات وی بدل شدند.

لورن روی با مطالعه عملکرد و شیوه سنجش زیبایی سیستم Face++ متوجه شد که این سیستم به صورت پیوسته زنانی که رنگ پوست تیرهتری داشتند را در دسته افرادی با جذابیت کمتر طبقهبندی میکند و صورتهایی که مشابه چهرههای اروپاییان بودند، برای مثال موی روشنتر و بینی کوچکتر داشتند، بدون توجه به رنگ پوستشان امتیاز بیشتری دریافت میکردند. این سوگیری نسبت به ویژگی چهرههای اروپایی در AI نشان میدهد افرادی که تصاویر را رتبهبندی کرده و برای آموزش و کدگذاری سیستم از آنها استفاده کردهاند، سوگیری داشتهاند. برای مثال، بر اساس استانداردهای زیبایی چین، پوست روشنتر، چشمان درشتتر و بینی کوچک از اهمیت بیشتری برخوردار است.

به عقیده وی امتیازاتی که میزان زیبایی افراد را تعیین میکنند بخشی از فرهنگ ناسالم زیبایی و الگوریتمهای توصیهگری است که روزانه در اینترنت به آنها برمیخوریم. برای مثال زمانی که بر مبنای این امتیازات مشخص کنیم چه پُستهایی بر روی پلتفرمهای شبکههای اجتماعی قرار بگیرند، معیارهای زیبایی و جذابیت تقویت میشوند و ماشین افرادی را که با معیارهاشان هماهنگ نیستند نادیده میگیرد. روی میگوید ما به نوعی «عکسهای که میتوانند در دسترس همگان قرار بگیرند را محدود میکنیم».

اما ایراداتی به این چرخه وارد است: اینکه افراد بیشتر به محتواهایی نگاه میکنند که افراد جذاب در آنها به چشم میخورد موجب میشود این تصاویر توجه افراد بیشتری را به خود جلب کنند و در نتیجه به افراد بیشتری نشان داده شوند. در نهایت، حتی اگر امتیاز بالای عکس عامل مستقیم نشان دادن این محتوا به شما نباشد، بی شک عامل غیرمستقیم آن است.

لورن روی در پژوهشی که در سال ۲۰۱۹ منتشر کرد، نحوه عملکرد دو الگوریتم را، یکی در زمینه پیشبینی سن و یکی در زمینه امتیازدهی به میزان زیبایی افراد، بررسی کرد. برای انجام این پژوهش، تصاویری از افراد به مشارکتکنندگان نشان داد و از آنها خواست میزان زیبایی افراد درون تصاویر را ارزیابی کنند و سن آنها را حدس بزنند. به گروهی از مشارکتکنندگان، پیش از اینکه جوابهایشان را اعلام کنند امتیازاتی که AI برآورد کرده بود نشان داد و به گروه دیگر این امتیازات را نشان ندادند. روی متوجه شد مشارکتکنندگانی که در جریان امتیازات و رتبهبندی AI قرار نگرفته بودند، سوگیری کمتری داشتند و در مقابل افرادی که در جریان نحوه رتبهبندی افراد بر اساس میزان جذابیت به وسیله AI قرار گرفتند، امتیازاتی نزدیک به امتیاز الگوریتم به افراد دادند. روی این پدیده را ‘anchoring effect’ مینامد.

وی میگوید: «الگوریتمهای توصیهگر در حال تغییر معیارها و استانداردهای ما هستند.» و «البته چالش از منظر فناوری این است که زیاد آنها را محدود نکنیم. زمانی که صحبت از زیبایی به میان میآید، این الگوریتمها بیشتر محدود میشوند.»

«دلیلی نمیبینم نواقص چهره افراد را به آنها گوشزد نکنیم، زیرا روشهایی برای رفع آنها وجود دارد.»

حسن مدعی است که تمام تلاشش را کرده تا مشکل سوگیری نژادی را حل کند. استودیو او در زمان تدوین یک گزارش کامل از تحلیل چهره- از آن دست گزارشاتی که مشتریان حاضرند در قبال پرداخت هزینه دریافت کنند- تلاش میکند با استفاده از داده ها چهره را بر اساس قومیت دستهبندی کند، در این حالت تمامی افراد بر مبنای معیارهای و استانداردهای زیبایی در اروپا سنجیده نمیشوند. به گفته حسن: «شما میتوانید سوگیریهای ناشی از معیارها و استانداردهای زیبایی در اروپا را فقط با نمایش گذاشتن زیباترین چهره از خودتان، بهترین چهره از قومتان، بهترین چهره از نژادتان دور بزنید.»

اما روی میگوید نگران است که این دستهبندیهای نژادی به زیرساختهای فنی هم نفوذ کنند. «مشکل این است که مردم این کار را انجام میدهند و نظر ما اصلا مهم نیست، هیچگونه نظارت و کنترلی بر آنها نیست.»

او میگوید: «ساده بگویم من هیچ وقت یک سیستم AI سنجش زیبایی که نسبت به فرهنگ حساس باشد را ندیدهام.»

لزومی ندارد سیستمهای توصیهگر را با هدف ارزیابی میزان جذابیت طراحی کنیم. هفته گذشته، BR، یک شبکه آلمانی، گزارش دارد که از هوش مصنوعی برای شناسایی کارکنانی استفاده شده که بر اساس ظاهر افراد، سوگیری دارند. در ماه مارس سال ۲۰۲۰، ByteDance، شرکت والد تیکتاک، به خاطر نامهای به تعدلیلکنندگان محتوا که از آنها خواسته بود ویدئوهایی با چهرههای زشت، افراد چاق، افرادی با نقص صورت، افرادی که فک جلویشان دندان ندارد، افرادی مسنی که چین و چروک زیادی دارند و غیره را حذف کنند، مورد انتقاد گرفت. توئیتر نیز اخیراً یک ابزار بُرش خودکار برای تصاویری ارائه داده که افراد سفیدپوست را در اولویت قرار میدهند. زمانی که این ابزار را بر روی تصاویر باراک اوباما و میچ مک کانل استفاده کردند، این ابزار برش خودکار عکس باراک را از تصویر حذف میکرد.

کدام یک منصفانهتر عمل میکند؟

وقتی برای اولین بار از طریق تماس تصویری با بنیانگذاری Qoves یعنی شفیع حسن صحبت کردم، به من گفت: « من همیشه تصور میکردم افراد جذاب نژاد به خصوصی دارند.»

بنیانگذاری Qoves گفت، زمانی که کار خود را در سال ۲۰۱۹ آغاز کرد، دوستان و خانوادهاش به آینده این کسبوکار خوشبین نبودند. اما به اعتقاد حسن کسبوکار او به افراد کمک میکند تا بهترینِ خود را ارائه دهند. او از فیلم گاتاکا (۱۹۹۷) الهام گرفت که در «آیندهای نه چندان دور» اتفاق میافتد، جایی که مهندسی ژنتیک تنها راه لقاح است. تبعیض ژنتیکی جامعه را تجزیه میکند، شخصیت اِتن هاوک، که تصور میشد فردی طبیعی و نرمال است، مجبور میشود هویت فردی که ژنتیکاش پذیرفتهشده و مقبول بود را بدزدد تا بتواند به سیستم نزدیک شود.

اغلب این فیلم را یک فیلم پادآرمانشهر قلمداد میکنند اما به عقیده حسن این فیلم تأثیری عمیق بر جای گذاشته است.

منبع: هوشیو